Se você está planejando dar boas-vindas aos futuros robô da inteligência artificial achando que eles são mais justos do que nossos líderes atuais, essa notícia é ruim.

Sistemas de Inteligência Artificial (IA) estão herdando nossos preconceitos.

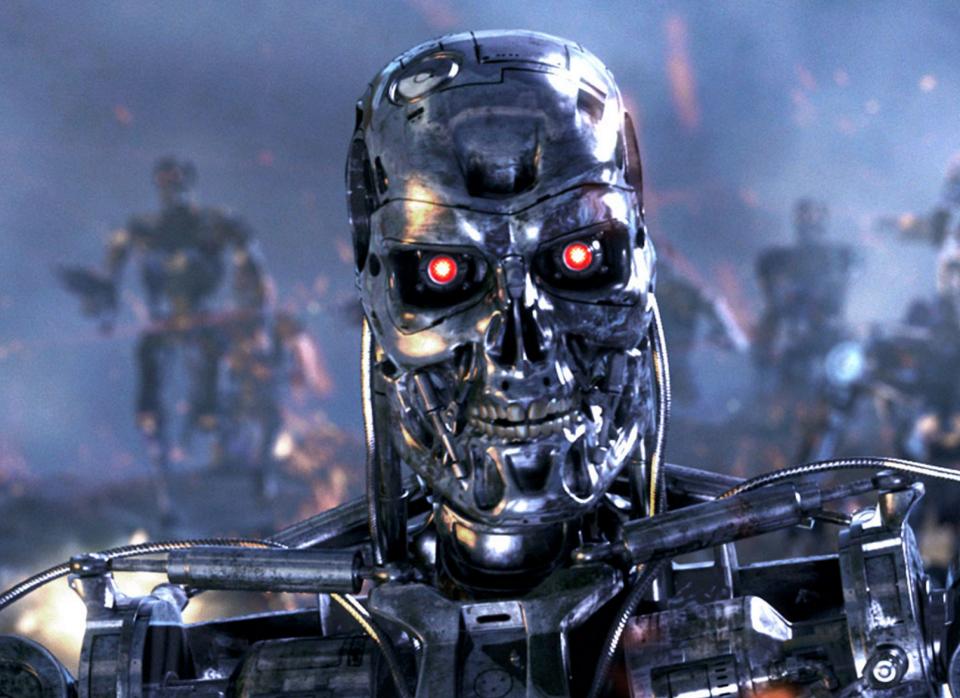

Talvez não vejamos robôs que queimem cruzes nos gramados dos grupos minoritários, mas podemos precisar de um esforço sério para fazer a IA transcender os piores aspectos da humanidade, ao invés de replicá-los.

Uma equipe da universidade de Princeton fez relatório sobre o que aconteceu quando eles expuseram um programa de IA chamado Global Vectors Word Representation (GloVe) a grandes quantidades de texto para que ele pudesse aprender associações entre palavras.

Infelizmente, como os textos vieram da Internet, nosso mundo foi refletido de volta para nós. "Os nomes femininos estão associados mais com os termos familiares, enquanto que os nomes masculinos estão associados mais com termos de carreira", disse o primeiro autor Dr. Aylin Caliskan. Em pouco tempo, GloVe estava fazendo suposições humanas comuns, como assumir o gênero de alguém com base em sua profissão. Similar tendências raciais também apareceram.

Ao contrário dos seres humanos, os robôs podem nascer tendenciosos, com os preconceitos de seus criadores sendo programados. No entanto, os autores apontam, mesmo aqueles construídos sem tais problemas podem desenvolver atitudes problemáticas a partir dos dados que são alimentados.

O problema da IA ??preconceituosa não é apenas teórico. Caliskan demonstrou que ao traduzir de línguas sem pronomes de género, o Google tradutor faz os mesmos pressupostos, com a tradução de trabalhos de alto status como masculino, enquanto alguém que detém um trabalho tradicionalmente feminino (e menos bem pago) é traduzido como "ela". Isto é presumivelmente a consequência das palavras que viu, ao invés de um programador instruindo o sistema de que as mulheres não podem ser médicas.

O estudo fornece alguma confirmação da hipótese de Sapir-Whorf, a idéia que a língua que nós usamos molda nosso pensamento.

Problematicamente, isso indica que todos nós provavelmente estamos absorvendo preconceitos simplesmente a partir da linguagem que usamos.